「AIの進化を支えているのは、GPUだけではない」

2026年2月12日、Samsung Electronicsが世界初となるHBM4の量産開始と顧客への出荷を発表しました。1スタックあたり最大3.3TB/sという驚異的なメモリ帯域幅は、従来のHBM3Eの2.7倍です。

「メモリの進化なんて地味な話」と思うかもしれません。しかし、ChatGPTのような大規模AIモデル、自動運転、科学計算のすべてが、このHBMメモリに依存しています。

この記事では、Samsung HBM4が何を可能にするのか、なぜ今量産が始まったのか、そしてこの技術革新が私たちの生活にどう影響するのかを徹底解説します。最後まで読めば、「なぜNVIDIAやAMDがHBM4を待っていたのか」が理解できます。

HBM4は何がスゴい?3つの進化ポイント

今回のHBM4は、ざっくり言うと「太く・速く・効率良く」を同時に押し上げた世代です。

1) 帯域幅:1スタック最大3.3TB/s

| メモリ規格 | 帯域幅(1スタック) | HBM4との差 |

|---|---|---|

| DDR5-6400 | 約50GB/s | 66倍 |

| GDDR6X | 約1TB/s | 3.3倍 |

| HBM3E | 約1.2TB/s | 2.7倍 |

| HBM4 | 3.3TB/s | – |

導入で触れた通り、HBM4は1スタックあたり最大3.3TB/s。HBM3E比で最大2.7倍という設計思想です。

TB/sはピンと来ない人も多いので、イメージを置くと

“GPUに流し込めるデータの水量”が大幅に増える感じです。AI訓練では、巨大な行列計算を回すほどデータの出入りが増えます。ここが太くなるほど、GPUが息切れしにくい。

注意点:DDR5やGDDRと単純比較する時は「土俵」が違う

DDRは“チャネル/モジュール”、HBMは“スタック(超広バス)”なので、倍率比較はあくまで目安です。

2) I/O:1,024→2,048ピンで「道幅」が倍

HBM4はI/Oピン数が増えています。

感覚的には道路の車線が倍になって渋滞が減る。帯域幅が伸びるのは、この“道幅の強化”が効いています。

3) 速度と効率:11.7Gbps(最大13Gbps)、電力効率+40%

HBM4はピン当たりの転送速度も引き上げています。さらに重要なのが、性能を上げつつ電力効率も改善している点。

データセンターでは電気代がガチで効くので、

「速い」だけでなく「同じ仕事をより少ない電力で」が価値になります。

容量も重要:24GB〜36GB、将来は48GBへ

HBMは「速さ」だけじゃなく、容量もAIに直結します。

HBM4は12層スタックで24GB/36GBの構成が中心になり、将来的には16層で48GB級も視野に入っています。

AIモデルは年々巨大化していて、メモリ容量が足りないと

- そもそも載らない

- 分割が必要になって遅くなる

- GPU枚数や通信が増えてコストが跳ねる

という現実が起きます。

だからメーカーは「帯域」だけでなく「容量」も全力で取りに行っています。

なぜ今、量産と出荷が“ニュース”になるのか

HBM4の発表が単なるスペック自慢で終わらない理由はシンプルです。

AIの需要は“GPU不足”より先に“メモリ不足”にぶつかる

生成AIの普及で、GPUの争奪戦が起きました。

でも実際は、GPUを揃えるだけでは足りません。

HBMがないと、AI用GPUは本領を発揮できない。

つまりHBMは、AIサーバーの性能と供給量を左右する“詰まりやすい場所”です。

だから「量産開始」「顧客へ出荷」は、

次世代AIインフラが現実に動き始めた合図になります。

HBM4はどこで使われる?NVIDIAとAMDが待っていた理由

HBM4が注目される最大の理由は、採用先がモンスター級だからです。

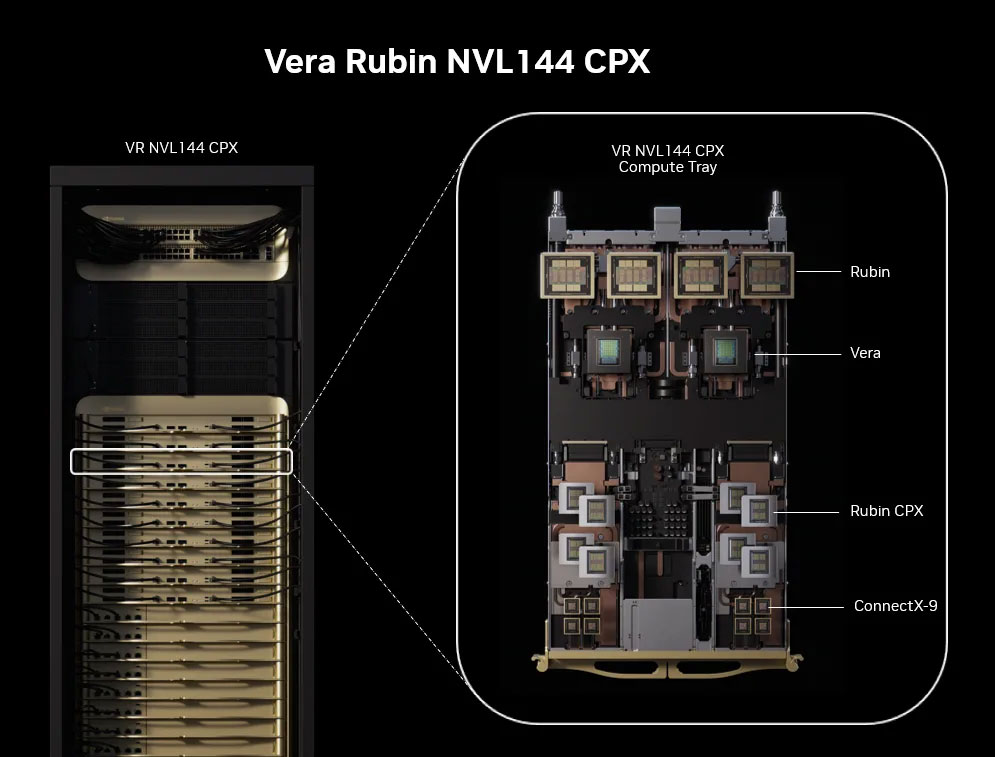

NVIDIA:Rubin世代がHBM4へ

NVIDIAの次世代データセンター向けGPU(Rubin世代)は、HBM4を前提にした構成が見込まれています。

現行BlackwellがHBM3Eなので、次の本命がHBM4という流れです。

NVIDIAはAI訓練市場で影響力が圧倒的なので、Rubinの本格展開はそのままHBM4需要を引っ張ります。

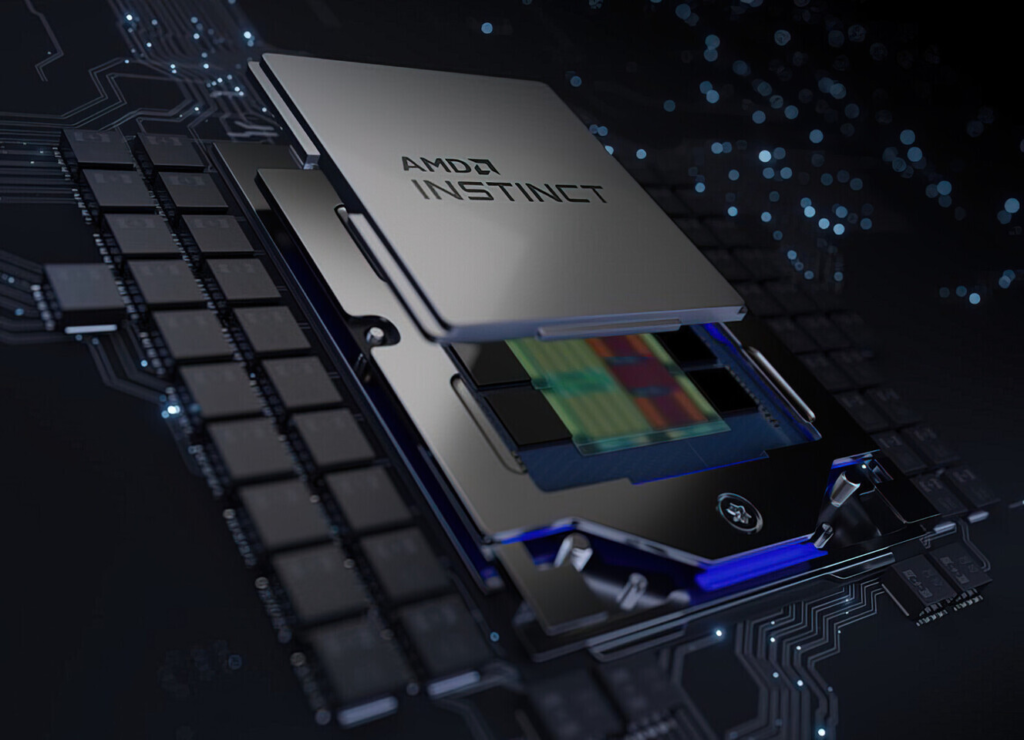

AMD:Instinct MI430Xで「432GB HBM4」

AMDはMI430Xで432GBのHBM4という“容量の暴力”を打ち出しています。

ここが面白いところで、AMDは単純な性能競争だけでなく、

- 1枚に大容量を載せる

- 巨大モデルを収めやすくする

- GPU枚数と構成コストを抑える

という方向でも勝負してきます。

要するに、HBM4は「次世代GPUのオプション」ではなく、

次世代GPUの設計そのものを成立させる前提パーツなんです。

HBM4がもたらす2つの変化

ここからは「私たちにどう効く?」の話。

1) AI訓練と推論の“伸びしろ”が広がる

HBM4は帯域幅が上がるので、メモリ律速になっている局面では性能向上が期待できます。

現実には演算・通信・並列化なども絡むため、すべてが比例して速くなるわけではありませんが、

“GPUを遊ばせない”方向に効くのが大きい。

結果として、モデル開発のサイクルが短くなりやすく、企業の開発競争も加速します。

2) データセンターの電力コストが効いてくる

電力効率が改善されると、スケールがデカい世界ほど効きます。

サーバーが何千台、何万台の世界では、数%の差が莫大なお金になります。

AIインフラは「性能」と同じくらい「電気代」が重要です。

HBM4は、そこに直球で刺さります。

Samsung vs SK hynix vs Micron:HBM覇権の行方

| メーカー | 推定シェア | 強み |

|---|---|---|

| SK hynix | 約50% | NVIDIA独占供給 |

| Samsung | 約35% | 製造キャパシティ |

| Micron | 約15% | 米国企業の強み |

HBM市場は実質3社の戦いです。

- SK hynix:HBMで強い実績(特にNVIDIA向けで存在感が大きい)

- Samsung:製造キャパと量産力、HBM4で巻き返しを狙う

- Micron:米国勢として存在感、AI投資の追い風も受けやすい

シェアは推計ソースや時期で差が出るので断定しにくいですが、構図としては

「SK hynixが先行、Samsungが量産力で追う、Micronも伸ばす」

が現在地です。

Samsungが「HBM4の量産開始」と「顧客出荷」を強調するのは、ここで主導権を取りに行く意思表示でもあります。

まとめ:HBM4はAI時代の“見えない主役”

もう一度、この記事の結論を短く。

- AIの進化を支えているのはGPUだけではない

- GPUが本気を出すには、HBMの帯域と容量が必要

- HBM4は、次世代AI/HPCの設計前提になるレベルの進化

- だからこそ「量産開始」「顧客出荷」がニュースになる

AI革命は、表側ではモデルやGPUが注目されます。

でも裏側では、HBM4みたいな“血管”が太くなって初めて、全身が速く動けるようになる。

次にNVIDIAやAMDの新製品ニュースを見る時は、ぜひスペック表の「HBM」にも注目してみてください。そこに、次の時代のヒントが隠れてます。

コメント